Parliamo di Google Images (o Google Immagini, se preferisci la versione italiana).

La ricerca inversa su Google

Sappiamo tutti (o almeno, dovremmo saperlo) che Google consente anche di fare ricerche per immagini. Ho una foto, voglio saperne di più – formalmente, voglio fare una Reverse Image Search, vale a dire: voglio trovare immagini correlate a quella che sto inserendo – la carico sul motore di ricerca. Oppure ne inserisco la URL. O, se ho scaricato l’estensione apposita per Chrome o Firefox, faccio tasto destro e posso ricercare nella banca dati di Google per le immagini. Qui c’è la guida di Google in merito.

Il motore di ricerca, a volte con enorme successo, a volte (la maggior parte delle volte) con grande fatica offre una SERP che contiene una serie di risultati che mostrano immagini «simili» e poi pagine che contengono quell’immagine o immagini simili.

Verifica

Si tratta di uno strumento molto prezioso – per quanto basilare – in sede di fact checking: vuoi verificare se è possibile che una data foto che sta girando sui social sia recente? La carichi su Google Images. Se la trovi altrove nel web, caricata in passato, ecco che non è recente.

Ma questa è una funzione che interessa, probabilmente, soltanto a giornalisti online e a «sbufalatori» di professione (in realtà, dovrebbe interessare tutti, visto che viviamo in un’ecosistema fatto di immagini che vengono pubblicate velocemente, quasi sempre senza alcuna verifica, e visto che noi stessi pubblichiamo, sui nostri profili social, per esempio. Essere certi di pubblicare immagini «validate» è un modo per rendere più pulito l’ecosistema del web.

Come funziona?

Non è qui, però, che volevo arrivare. Sul funzionamento del motore di ricerca per immagini di Google c’è una bella risposta su Quora da parte di un ingegnere di Google, Sam Gendler (Engineer in search infrastructure at Google, Inc.). Notate che spesso accade che Google fornisca risposte a domande sul proprio funzionamento tramite persone che lavorano al proprio interno. Sono da ritenersi risposte ufficiali? O ufficiose? Impossibile a dirsi, ma sono comunque molto interessanti da analizzare. Poi c’è tutto l’archivio di documentazioni che invece Google stesso ha ritenuto di rendere pubblico. Eccolo.

Consigli SEO

Per capire cosa c’è in un’immagine, oltre a strumenti più o meno sofisticati di AI, Google utilizza anche elementi molto basici.

Per esempio: tutti i dati e metadati dell’immagine eventualmente inclusi nel file, la URL dell’immagine, la URL della pagina su cui l’immagine giace, Il contenuto della pagina o del sito su cui l’immagine si trova e quali parole sono «vicine» all’immagine o si riferiscono all’immagine stessa. Se l’immagine ha anche un link nella pagina, si utilizza anche quel link (o altri contenuti nella pagina stessa). Tutti i contenuti della pagina che specificano meglio l’immagine vengono letti da Google.

Basta questo elenco – tratto e liberamente tradotto dalla risposta di cui sopra – per rendersi conto di una cosa molto importante: se vogliamo che le pagine dei nostri siti siano bene indicizzate da Google e acquisiscano posizionamento, dobbiamo prenderci cura delle immagini. Nominare i file in maniera pertinente, compilare gli attributi alt, title e description, inserire le immagini in pagine contestualmente pertinenti e via dicendo. Questi consigli fanno parte, per quel che mi riguarda, dell’ABC della SEO.

Tag “semantiche”

Il punto a cui volevo arrivare è proprio questo. Dal 2015, più o meno,Google Images offre i propri risultati con una funzionalità aggiunta. Propone una tag “semantica” che dovrebbe essere il risultato più pertinente possibile per categorizzare l’immagine che gli è stata proposta. Uso la parola “semantica” fra virgolette, perché tutte le volte che si parla di “semantica” associata alla SEO nascono aberrazioni filosofico-fuffare da evitare come la peste.

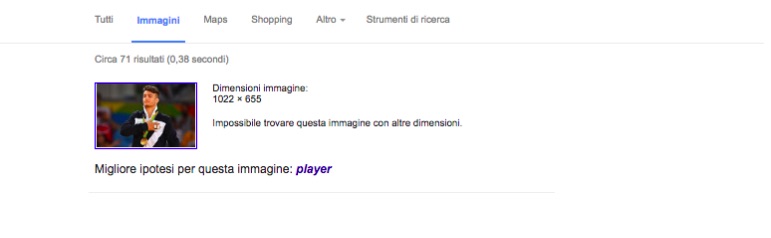

Per esempio, ho provato a caricargli un’immagine che raffigura Fabio Basile, il giovane vincitore dell’oro nel judo 66kg alle Olimpiadi di Rio 2016 Google fa un po’ fatica a riconoscerlo, ma mi offre come risposta «player».

Per la precisione dice: «Migliore risposta per questa immagine: player». Non avendo molte altre occorrenze per Fabio Basile, l’algoritmo di Google fa del suo meglio, diciamo così. Nella SERP poi propone

Fra le immagini visivamente simili altri «player»

- Fra le pagine che contengono immagini corrispondenti, trova quelle che effettivamente hanno quell’immagine caricata

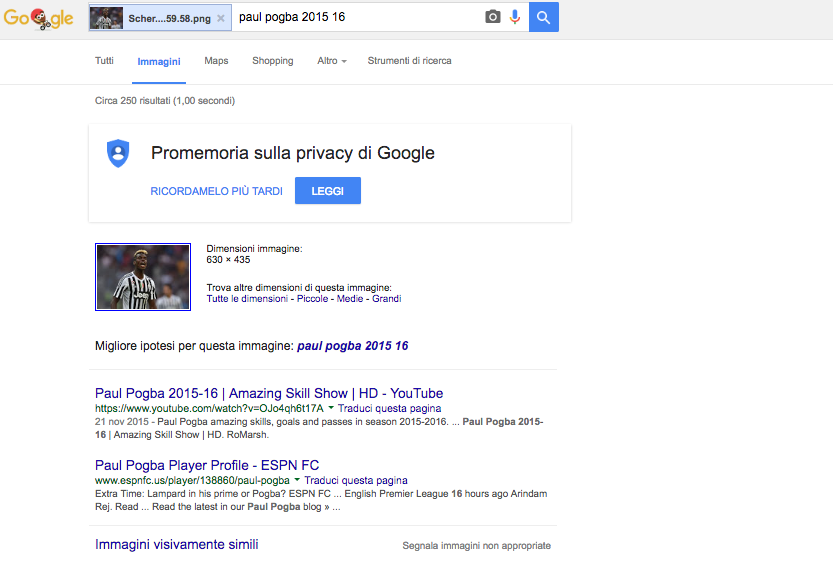

Se gli rendo la vita un po’ più facile e cerco, per esempio, un’immagine di Paul Pogba il risultato è davvero impressionante.

La tag «semantica» che Google associa a questa immagine è «Paul Pogba 2015 16». Effettivamente, l’immagine, oltre a mostrare il calciatore, lo ritrae in una partita disputatasi proprio nella stagione calcistica precedente.

Questo significa che in presenza di occorrenze precise e di un volume di dati significativo, Google è in grado di «capire» e offrire come risultato il contenuto esatto dell’immagine, almeno per tag principale.

Può sembrare ancora rudimentale, ma è una funzione da tenere d’occhio attentamente: oltre a darci, come visto, suggerimenti SEO, sarà una delle evoluzioni delle funzionalità dei motori di ricerca.

Quanto sia importante per Google la componente visiva lo prova anche la modifica che è stata realizzata nel 2017 alla pagina dei risultati delle immagini, molto simile a un social fotografico e con le tag in bella vista.

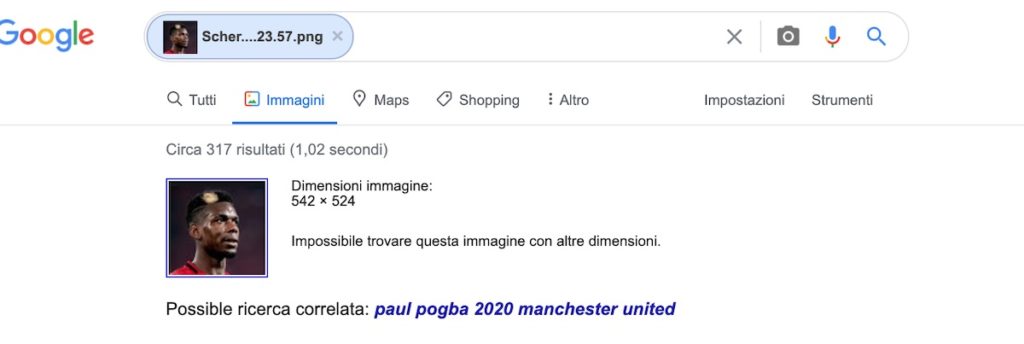

Qualche anno dopo, nel 2019, la medesima ricerca in Google Images ti mostra non solo l’evoluzione per immagini del personaggio in questione, ma anche il modo in cui Google testa e poi modifica sé stesso graficamente (e non solo): vedi che, per esempio, i colori delle tag sono stati dismessi e, contemporaneamente, il tagging sembra più preciso.

Contemporaneamente, possiamo verificare che in termini di riconoscimento generico delle immagini, Google ha fatto passi da gigante. Ho provato a dargli in pasto una foto del mio cane. Ecco cosa dice l’1 febbraio 2019.

Lo riconosce come “border collie pelo corto”. Corretto. Ti faccio notare che Google ha cambiato la dicitura: se prima diceva “migliore ipotesi per questa immagine” adesso ti dice “possibile ricerca correlate”. Questo ha comportato un cambio radicale di esposizione in SERP immagini anche per quanto riguarda le persone. Guarda cosa succede se carico un’immagine di Pogba.

Possibile che Google non lo riconosca più? Assolutamente no: questo è chiaramente un cambio dovuto a questioni legate alla privacy. Probabilmente anche al GDPR.

L’algoritmo di riconoscimento continua a migliorare, i risultati esposti si contengono un minimo.

A luglio del 2020, Google se la cava nuovamente con il “Possibile ricerca correlata”.

(AP)

(Pubblicato la prima volta ad agosto del 2016, aggiornato l’1 agosto 2017 e poi aggiornato nuovamente l’1 febbraio 2019 e il 21 luglio 2020)